智谱开源GLM-4.6V系列多模态大模型

12月8日,智谱AI开源了GLM-4.6V系列多模态大模型。这一发布在技术层面带来两个重要进展:原生多模态工具调用能力和超十万token上下文窗口。

GLM-4.6V包含两个版本。GLM-4.6V主模型采用超百亿总参数,约120亿激活参数的MoE架构,面向云端和高性能集群部署。GLM-4.6V-Flash则是9B参数的轻量版本,针对本地部署和低延迟场景优化,免费提供使用。

从技术角度看,GLM-4.6V的显著特性在于原生Function Calling能力。模型可以直接处理图像、截图作为工具输入参数,无需先转换为文本描述。视觉输出(如图表、网页渲染结果)也能被模型直接解析并整合进推理链路。这打通了从"视觉感知"到"可执行动作"的完整通路,为多模态Agent提供了统一的技术基座。

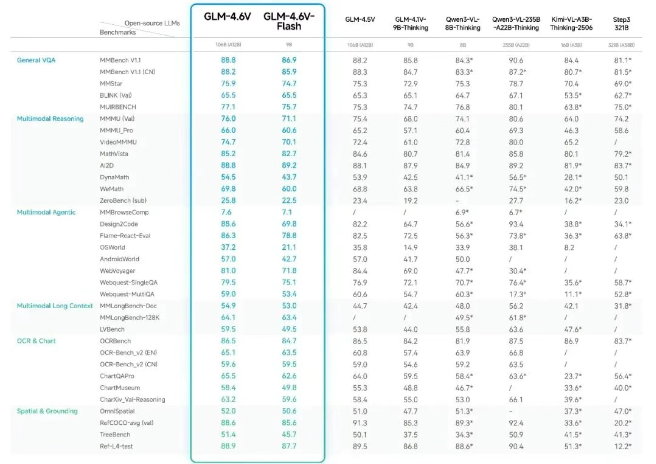

GLM-4.6V 还在 MMBench、MathVista、OCRBench 等 30+ 主流多模态评测基准上进行了验证,较上一代模型取得显著提升。在同等参数规模下,模型在多模态交互、逻辑推理和长上下文等关键能力上取得 SOTA 表现。其中,9B 版本的 GLM-4.6V-Flash 整体表现超过 Qwen3-VL-8B,106B 参数 12B 激活的 GLM-4.6V 表现比肩 2 倍参数量的 Qwen3-VL-235B,看起来很强。

相比前代GLM-4.5V,新版本在成本控制上也有明显改进。API调用价格降低50%,输入为每百万tokens仅需一元,输出为三元。

在测试过程中,亲自实测了内容创作与知识分发场景中,可以从多模态输入中,自动构建高质量图文输出:无论是直接输入图文混杂的论文、研报、PPT,还是只给出一个主题,模型都能生成结构清晰、图文并茂的社交媒体内容。

而且这个视觉推理模型GLM-4.6V不仅是新发布,还做了开源,接下来应该就是开源周了吧,越来越期待了,不知道下一步还会有什么。狠狠期待一下接下来的更多惊喜吧,感觉不会让我们失望的。