阿里开源 Qwen3-TTS:多语言 + 低延迟 + 高保真,开源语音模型新标杆

2026-01-24 11:20

192

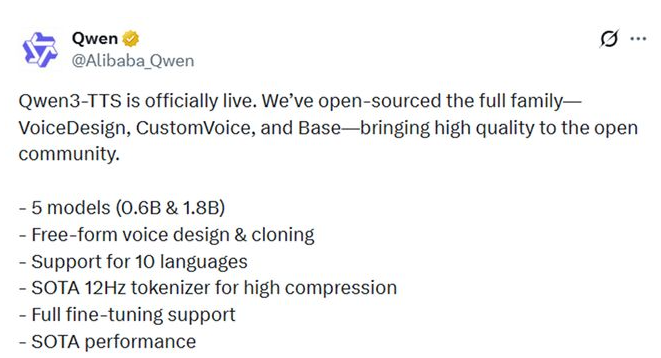

2026年1月23日,阿里巴巴千问实验室正式开源语音合成模型Qwen3-TTS,涵盖从基础到定制的全系列模型(0.6B轻量版、1.7B性能版),以“多语言流畅切换、3秒语音克隆、超低延迟实时输出”三大核心能力,打破传统TTS技术瓶颈,同时通过创新架构与训练方法,兼顾高音质与高效率,成为当前开源领域性能最强的AI语音模型之一。

一、开源概况:全链路开放,快速上手无门槛

1.核心资源与平台

开源范围:完整开放模型权重、代码、论文及API,提供“VoiceDesign(音色创造)、CustomVoice(定制音色)、Base(基础生成)”全家桶能力;

获取渠道:支持多平台访问——

模型版本:提供两种参数规模,适配不同场景——

0.6B版:平衡性能与效率,适合端侧或资源有限场景;

1.7B版:追求极致音质与控制能力,适合专业级语音生成。

2.核心功能:覆盖“生成-克隆-定制”全需求

多语言与方言支持:流畅切换中文(含四川话、上海话等方言)、英文、日语、韩语等10种语言,跨语言合成错误率显著降低(如中文到韩语错误率降66%);

3秒语音克隆:仅需3秒参考音频,即可精准还原说话人音色、语气与韵律,零样本克隆词错误率低至1.24,相似度达0.95(接近真人);

自然语言定制音色:通过文字描述即可生成专属声线(如“四川话、语速慢、温柔语气”),支持调控情感、韵律等声学属性,实现“所想即所听”;

长语音生成:最大处理长度提升至32768 token,可轻松生成10分钟以上流畅语音,词错误率仅1.5,无重复、遗漏问题。

二、技术创新:双token器+双轨架构,破解TTS核心痛点

Qwen3-TTS的突破源于底层技术重构,解决传统TTS“音质与延迟不可兼得、级联误差、长语音卡顿”等问题:

1.双语音token器:按需选择“高保真”或“低延迟”

创新设计两套独立token器,适配不同场景需求:

25Hz单码本token器:主打高保真,基于Qwen2-Audio训练,分两步优化(先学语音识别、再还原细节),搭配滑动窗口技术,适合专业配音、有声书录制等对音质要求高的场景;

12Hz多码本token器:主打超低延迟,将语音拆解为“语义+声学”双维度,无需等待完整文本即可实时处理,端到端延迟低至97ms(眨眼级响应),适合智能助手、在线会议翻译等实时交互场景。

2.双轨模型架构:文本与声音独立处理,避免级联误差

采用“离散多码本LM架构”,摒弃传统“语言模型+声学模型”的级联设计:

一套轨道专注文本语义理解,精准捕捉输入文本的逻辑与情感;

另一套轨道专注语音特征生成,结合说话人embedding还原音色细节;

创新Dual-Track混合流式生成技术,单模型同时支持“流式生成(逐字输出)”与“非流式生成(整句输出)”,兼顾实时性与完整性。

3.分阶段训练:海量数据+精细优化,兼顾能力与稳定性

预训练阶段:用5000万小时多语言语音数据打基础,先掌握不同语言的语音规律,再用高质量数据优化音质,最后专项提升长文本处理能力;

后训练阶段:通过人类反馈调整声音偏好、规则奖励增强稳定性、轻量化微调配适特定音色,确保生成语音既自然又符合用户习惯。

三、性能表现:多维度测试霸榜,远超同类模型

1.核心指标领先

测试场景关键数据行业对比优势

语音重建相似度0.95,可懂度、质量评分接近真人12Hz token器各项指标排名第一

零样本语音克隆1.7B版词错误率1.24低于多数商业模型,10种语言保持高相似度

长语音合成10分钟以上语音词错误率1.5无重复、韵律连贯,远超传统TTS

实时流式生成单用户延迟97ms,6用户并发延迟<300ms(RTF 0.43)满足智能客服、语音助手等实时场景需求

2.指令遵循与表现力

在InstructTTS-Eval基准测试中,Qwen3-TTS的指令遵循能力(如按描述调整语气)与表现力,显著超越MiniMax-Voice-Design等开源模型,尤其在“文本语义-语音情感自适应”上表现突出(如悲伤文本自动降低语速、提升音调低沉度)。

四、应用场景:覆盖个人到企业全需求

结合技术特性与开源属性,Qwen3-TTS可适配多领域场景:

内容创作领域:短视频配音、播客制作、有声书录制,创作者可克隆个人声音生成系列内容,或为动画、小说角色定制专属声线,方言爱好者可低成本制作地方特色音频;

企业级交互场景:智能客服、虚拟人、IVR语音导航,企业可克隆品牌专属音色实现全渠道语音一致性,依托低延迟特性打造实时响应的智能助手,支持多语言服务全球化用户;

教育与娱乐产业:多语言教学音频生成(适配沉浸式语言学习)、游戏角色方言配音(提升玩家沉浸感)、影视备用配音(加速制作流程);

二次开发与定制:开发者可基于开源模型微调,适配医疗、金融等垂直领域(如专业医疗语音播报),或集成到RAG知识库、自动化办公工具,搭建“文本转语音+场景化交互”方案。

Qwen3-TTS的开源不仅打破了高质量语音合成的闭源壁垒,更通过“轻量化模型+低延迟+多语言”的组合,将技术门槛从“专业团队”拉至“个人开发者”,让中小团队与普通用户也能享受媲美商业模型的语音生成能力。其双token器、双轨架构的设计思路,也为后续TTS技术发展提供了可复用的范式,推动行业从“单一追求音质”转向“按需匹配场景”的多元化发展。

如需快速体验,可直接访问Hugging Face或ModelScope的在线Demo,输入文本并描述语音需求(如“用温柔的英语播报新闻”),几秒内即可生成并下载音频;开发者可通过GitHub获取代码,根据场景选择0.6B或1.7B模型进行部署与微调。

0

好文章,需要你的鼓励