医疗 AI 大洗牌!斯坦福、普林斯顿发布首个医学世界模型 MedOS

2026-02-23 12:10

53

2026年2月,医疗AI领域迎来里程碑式突破——斯坦福大学丛乐、鲍哲南团队联合普林斯顿大学王梦迪团队,携手NVIDIA等机构正式发布全球首个通用医疗具身世界模型MedOS。

这款融合AI、扩展现实(XR)与协作机器人(Cobot)的三位一体系统,彻底打破了传统医疗AI“只会分析数据、无法介入物理世界”的局限,标志着医疗智能从“虚拟辅助”迈入“实体协同”的全新时代,一场覆盖诊疗全流程的行业洗牌正式拉开序幕。

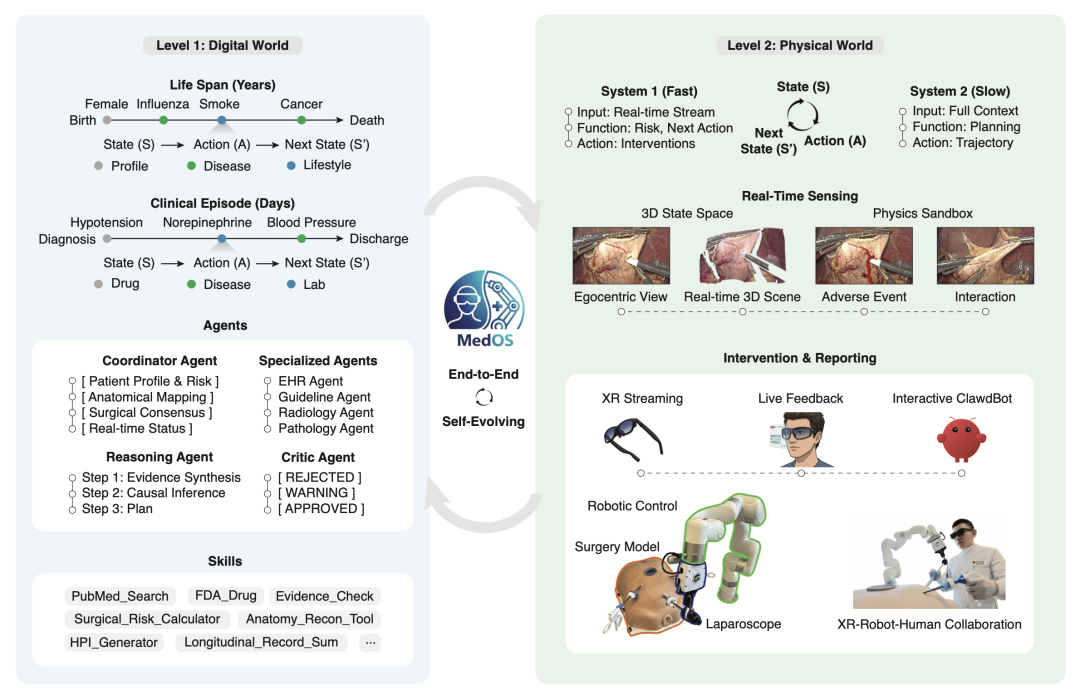

MedOS的横空出世,直指传统医疗AI的核心痛点:缺乏对医疗物理现实的深层理解。过去的AI工具能解读影像、分析病历,却无法预判药物注入后的机体反应,也无法感知手术操作带来的组织力学变化。而MedOS通过构建“状态-动作-转换”(State-Action-Transition)的完整医疗闭环,首次让AI具备了“看懂人体、模拟诊疗、执行干预”的全链条能力,真正成为医生的“智能副驾驶”。

其核心架构的创新之处,在于完美复刻了资深医生的双系统认知模式。System 1(快思考)负责急诊抢救、术中突发等毫秒级响应场景,通过实时边缘推理提供超越人类神经传导速度的应急方案,在血压骤降、术中出血等危机关头快速给出干预建议;System 2(慢思考)则像经验丰富的全科专家,整合患者病史、检验数据、影像信息进行长链条临床推演,为复杂并发症、多系统疾病制定从诊断到康复的最优路径。这种“直觉+逻辑”的双轨设计,让MedOS既能应对急症的瞬息万变,又能驾驭疑难杂症的复杂决策。

支撑这份强大能力的,是迄今为止规模最大的开源临床视觉数据集MedSuperVision。该数据集包含85,398分钟的高保真医疗影像与操作数据,不仅覆盖外科手术视野,更记录了人体组织在各类诊疗干预下的动态反馈,让模型从底层理解医疗物理学规律,具备跨科室的通用适配能力。目前,该数据集已在GitHub上线,星标数量快速攀升至3.2k,吸引全球上千名医疗AI开发者参与优化。

在临床应用层面,MedOS展现出颠覆式价值。在诊断环节,它能通过XR设备捕捉血流变化、组织物理属性等细微特征,精准识别隐蔽病灶;在治疗规划阶段,其数字孪生推演引擎可模拟不同方案的实施效果,预判手术风险与药物不良反应,让医生在真实干预前优化方案;在执行层面,它能驱动协作机器人完成精准操作,消除人类医生的生理震颤,甚至在医生疲惫时将其操作表现拉回最佳状态。

更深远的意义在于,MedOS正在推动“医疗平权”成为现实。人机协作实验显示,在它的辅助下,青年医生、医学生甚至护士的诊断与操作准确率,能直接提升至资深医师水平,让顶尖专家的隐性知识通过算法下沉到基层医疗。对于医疗资源匮乏的偏远地区,MedOS的基层医院专属套餐每年费用仅50-100万元,远低于同类系统,有望彻底改变“看病难、看专家难”的现状。

除了临床诊疗,MedOS还是高效的医学科研助手。它具备自主临床发现能力,面对复杂癌症病例时,能自动识别多基因突变、调用TCGA数据库挖掘共突变基因,并通过Kaplan-Meier生存分析生成详尽预后报告;在代谢通路与免疫治疗耐药性研究中,可整合21个临床队列进行差异表达分析,为新药研发提供关键支撑,相当于一位24小时不间断工作的医学博士后。

不过,MedOS的落地普及仍面临挑战。数据安全方面,海量患者生理与诊疗数据的存储使用需建立严格防护体系;基层适配层面,需应对不同医院设备条件、数据完整性差异带来的“水土不服”;而人文关怀层面,AI终究无法替代医生的临床经验与情感支持,如何实现技术辅助与人文关怀的平衡,仍是行业需要探索的课题。

目前,MedOS暂未完全开源,仅向合作科研机构和医疗机构开放核心接口,基础使用权限免费,高级诊疗模块按机构规模付费。随着MedSuperVision数据集的持续优化与开发者社区的参与,未来有望开放更多核心功能。

MedOS的发布,不仅重构了医疗AI的技术格局,更重新定义了AI在医疗领域的角色——它不再是孤立的分析工具,而是深度融入诊疗全流程的“具身协同者”。

从基层医院的常见病诊疗到三甲医院的复杂手术规划,从慢病管理到新药研发,MedOS正在让优质医疗资源触手可及。这场由顶尖学府引领的医疗智能革命,终将打破医疗资源不均的壁垒,让每一位患者都能享受到精准、高效、可及的医疗服务,开启通用医疗AI的全新纪元。

0

好文章,需要你的鼓励