DeepSeek V4 发布进入最后倒计时:编码之王即将登场?

2026-02-24 10:52

38

2月24日消息,多方信源显示,中国AI公司深度求索(DeepSeek)的下一代旗舰模型 DeepSeek V4 正处于发布前的最后阶段。CNBC 于2月23日发文警告,V4的发布"迫在眉睫",可能再次引发美股科技板块震荡。

发布时间:已过预期窗口,"随时可能上线"

据路透社和 The Information 此前援引知情人士消息,DeepSeek 内部的目标发布日期为2月17日(农历新年),延续了去年 R1 在春节前夕发布的策略。然而截至2月24日,DeepSeek 官方尚未正式宣布 V4 的发布。

CNBC 2月23日的报道指出,尽管 DeepSeek 尚未公布确切日期,但考虑到农历新年假期已于上周结束,发布被认为"即将到来"。Futurism 同日刊文称美国AI行业正为 V4 的到来"瑟瑟发抖"。

需注意: 预测市场 Manifold 上有用户声称 V4 已于2月17日上线,但这与 CNBC 2月23日"尚未官宣"的报道存在矛盾,目前无法完全确认。

三大核心技术:不是修修补补,而是架构级重构

根据 DeepSeek 在2025年底至2026年初发表的多篇公开论文,V4 整合了三项关键技术创新:

Engram 条件记忆系统(2026年1月13日论文):将静态知识检索与动态推理解耦,实现 O(1) 常数时间知识查询。实测在"大海捞针"测试中从84.2%提升至97%,对长上下文编码任务意义重大。

mHC 流形约束超连接(2025年12月31日/2026年1月1日论文,创始人梁文锋联合署名):通过 Sinkhorn-Knopp 算法将信号放大控制在1.6倍(传统方法为3000倍),使4倍宽的残差流仅增加6.7%训练时间开销。

DSA 稀疏注意力机制:在 V3.1/V3.2 基础上优化,使用轻量级索引模型从全部上下文中筛选出最相关的2,048个token,据称可将推理计算成本降低约50%。

性能预期:内部测试称超越 Claude 和 GPT,但仍需独立验证

据 Reuters 和 Decrypt 等多家媒体报道,DeepSeek 内部测试显示 V4 在长上下文编码任务上优于 Claude 和 ChatGPT 系列。V4 据称拥有超过100万token的上下文窗口,可一次性处理整个代码仓库。

不过,这些成绩尚未经过独立评测验证。目前 SWE-bench 编码基准的领先者是 Claude Opus 4.5(80.9%),V4 需要超过这一门槛才能坐实"编码之王"的称号。考虑到 DeepSeek 一贯低调务实的风格(不同于许多公司的营销夸大),业内对这些数据的可信度持谨慎乐观态度。

V4 Lite 已泄露:SVG 生成能力惊艳

Dataconomy 于2月23日报道,DeepSeek V4 Lite 已通过非官方渠道流出。测试显示该精简版在 SVG 代码生成方面表现出色——仅用54行代码生成了一个 Xbox 手柄的精细矢量图,42行代码完成了一个多元素场景。内部评估显示其代码优化程度优于 DeepSeek V3.2、Claude Opus 4.6 和 Gemini 3.1,但这些结果仍需独立验证。

市场影响:华尔街如临大敌

CNBC 提醒投资者,去年1月 DeepSeek R1 发布时,Nasdaq 综合指数单日下跌3%,英伟达暴跌17%、蒸发6000亿美元市值。如今美国科技巨头(亚马逊、微软、Meta、谷歌)在AI领域的支出已飙升至更高水平,2026年预计总投入将达6500亿美元。

Motley Fool 分析指出,即使 V4 不能全面超越所有美国模型,只要展现出足够的竞争力,就可能再次引发市场对"AI投入是否值得"的质疑。

关键信息速览

项目 | 详情 |

|---|---|

模型名称 | DeepSeek V4(内部代号 MODEL1) |

开发公司 | 深度求索(DeepSeek),总部杭州 |

预期发布 | 2026年2月,已过原定窗口期,官宣日期待定 |

核心定位 | 编码能力 + 长上下文处理(100万+ token) |

架构特征 | 混合推理/非推理模型(可能统一 V3 和 R1 产品线) |

核心技术 | Engram 条件记忆 + mHC 超连接 + DSA 稀疏注意力 |

参数规模 | 传闻约1万亿总参数(MoE架构,活跃参数约370亿) |

开源预期 | 大概率延续 Apache 2.0 开源传统 |

硬件要求 | 消费级:双 RTX 4090 或单 RTX 5090 即可本地部署 |

API 定价 | 未公布,预计延续低价策略(当前模型约 $0.55/百万token) |

生态热度:社区已在提前准备

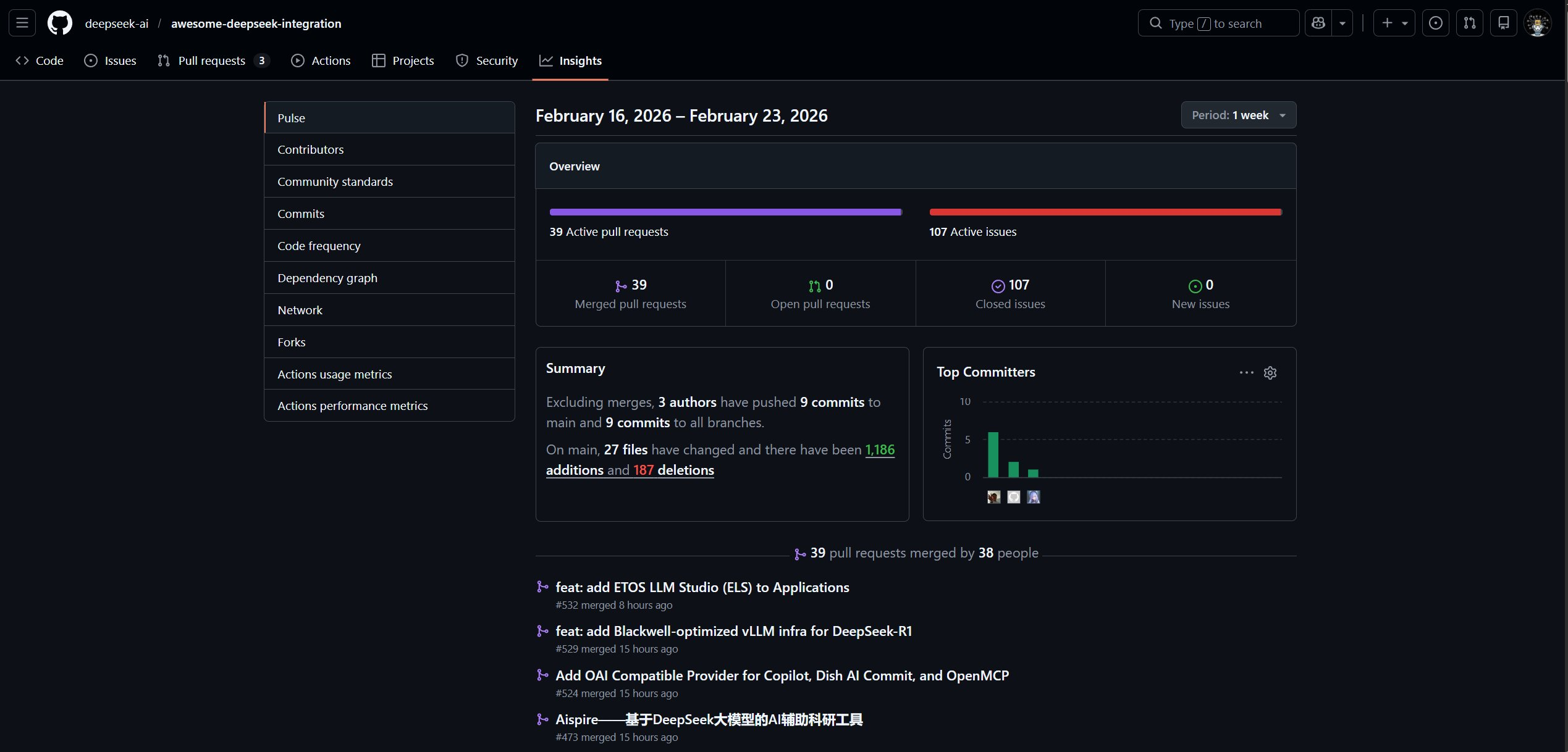

DeepSeek 在 GitHub 上的社区生态仓库

awesome-deepseek-integration 近一周内合并了39个 PR,涉及 ETOS LLM Studio、Blackwell 优化 vLLM 基础设施、OAI 兼容接口等第三方集成项目。虽然这些是社区开发者贡献而非模型核心代码,但反映出开发者生态对 V4 到来的积极准备。Reddit r/LocalLLaMA 社区讨论热度持续走高,开发者们已在搭建部署管线和评测框架,准备第一时间接入 V4。

DeepSeek V4 的热度并非空穴来风——背后有扎实的公开论文支撑、可信的媒体报道佐证,以及生态系统的实际准备动作。但我们也提醒读者:在独立基准测试结果公布之前,所有性能宣称都应审慎看待。DeepSeek 的优势不仅在于模型能力本身,更在于"开源 + 低成本 + 消费级硬件可部署"的组合拳——这才是真正可能重塑行业格局的力量。

我们将在 V4 正式发布后第一时间推出详细评测和接入指南,敬请关注。

0

好文章,需要你的鼓励