Anthropic 指控DeepSeek、Moonshot、MiniMax ,马斯克反击Anthropic 称他们也是小偷

2026-02-24 10:58

33

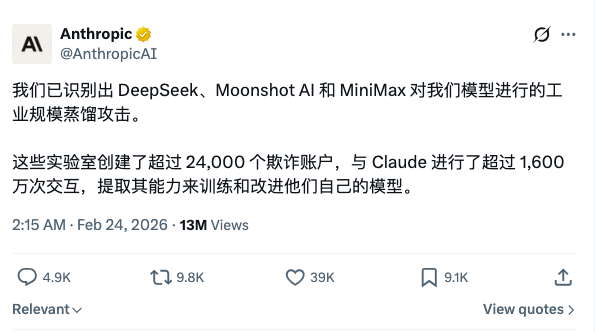

2月23日,Anthropic 在官方博客发布重磅长文《Detecting and preventing distillation attacks》(检测与防范蒸馏攻击),公开指控三家中国AI实验室——DeepSeek、Moonshot AI(月之暗面)和 MiniMax(稀宇科技)——对其旗舰模型 Claude 实施了"工业规模"的非法蒸馏攻击。

消息一出,Bloomberg、TechCrunch、Tom's Hardware、Engadget、CyberScoop 等主流科技媒体迅速跟进报道,X(原推特)平台讨论量激增。与此同时,Elon Musk 即时发帖反击,嘲讽 Anthropic"自己也因大规模窃取训练数据付过数十亿美元和解金"。这场围绕AI知识产权的中美争议正在全面发酵。

Anthropic 披露了什么?

根据 Anthropic 官方博客,三家中国实验室通过以下手段系统性提取 Claude 的能力:

规模数据: 共创建超过24,000个欺诈账户,与 Claude 产生超过1,600万次交互。其中 MiniMax 的规模最大(超过1,300万次),Moonshot AI 次之(超过340万次),DeepSeek 数量最少但最具技术针对性(超过15万次)。

攻击手法: 三个攻击活动使用了类似的策略——通过商业代理服务转售 Claude 的访问权限,搭建 Anthropic 所称的"水螅集群"(hydra cluster)架构:大规模欺诈账户网络将流量分散到 Anthropic API 和第三方云平台上。在一个案例中,单个代理网络同时管理超过20,000个欺诈账户,并将蒸馏流量与正常客户请求混合以逃避检测。

各家攻击重点不同。 据 TechCrunch 报道,DeepSeek 主要针对推理能力,包括审查安全查询的替代方案;Moonshot AI 针对智能体推理、工具使用、编码和计算机视觉能力;MiniMax 则针对智能体编码和工具编排。Anthropic 在博文中表示,他们"以高置信度"通过 IP 地址关联、请求元数据和基础设施特征锁定了攻击来源,并与行业合作伙伴交叉验证。

关键发现之一: Anthropic 声称在 MiniMax 的攻击仍在进行时就检测到了该活动——在 MiniMax 发布其正在训练的模型之前——这使 Anthropic 获得了对蒸馏攻击完整生命周期的"前所未有的可见性"。当 Anthropic 在 MiniMax 活动期间发布新模型时,MiniMax 在24小时内便将近一半流量转向新模型。

Anthropic 的核心论点

Anthropic 在博文中明确区分了合法蒸馏与非法蒸馏:前沿实验室日常使用蒸馏技术为客户创建更小、更便宜的模型版本,这是合法的。但竞争对手利用蒸馏窃取他人能力,以极低成本和时间获取原本需要独立开发的技术——这构成违反服务条款和地区访问限制的行为。

Anthropic 出于国家安全原因目前不向中国提供 Claude 的商业访问,也不向其位于境外的子公司提供服务。三家实验室的行为直接违反了这一政策。

国家安全层面, Anthropic 警告称,通过非法蒸馏构建的模型不太可能保留原模型的安全防护措施,意味着"危险能力可能在安全保护被完全剥离的情况下扩散"。博文指出,这些未设防的模型可能被用于"进攻性网络行动、虚假信息运动和大规模监控"。

芯片出口管制层面, Anthropic 明确将蒸馏攻击与出口管制辩论挂钩,称大规模蒸馏同样需要先进算力支撑,因此"蒸馏攻击强化了出口管制的合理性:限制芯片获取既能限制直接的模型训练,也能限制非法蒸馏的规模"。CrowdStrike 联合创始人 Dmitri Alperovitch 向 TechCrunch 表示:"很长一段时间以来,中国AI模型快速进步的部分原因就是通过蒸馏窃取美国前沿模型。现在我们有了确凿的事实。"

据 TechCrunch 报道,该指控发布的时机正值美国就AI芯片出口管制展开激烈辩论。上月特朗普政府正式允许英伟达等公司向中国出口 H200 等先进AI芯片,批评者认为这一放松举措在关键时刻增强了中国的AI算力。

Musk 反击:你们自己也是"窃贼"

Anthropic 博文发布数小时后,Elon Musk 在 X 平台直接回应,原文为:

"Anthropic is guilty of stealing training data at massive scale and has had to pay multi-billion dollar settlements for their theft. This is just a fact."(Anthropic 因大规模窃取训练数据而有罪,并因其盗窃行为不得不支付数十亿美元的和解金。这只是事实。)

Musk 所指的确有事实依据。2025年9月,据 PBS 和 NPR 报道,Anthropic 同意支付15亿美元与书籍作者集体诉讼达成和解。联邦法官 William Alsup 在6月的裁决中认定,Anthropic "明知是盗版"仍下载了超过700万本数字化书籍用于训练 Claude——其中约20万本来自 Books3 数据集,至少500万本来自盗版网站 Library Genesis,至少200万本来自 Pirate Library Mirror。作为和解协议的一部分,Anthropic 同意销毁原始下载的书籍文件。

社交媒体:嘲讽声与支持声并存

据 Decrypt 报道,Anthropic 的声明在 X 平台上引发了大量质疑和嘲讽。AI基础设施公司 IO.Net 联合创始人 Tory Green 写道:"你们在开放互联网上训练,然后当别人从你们身上学习时就叫它'蒸馏攻击'。" 知名AI安全研究者 Pliny the Liberator 调侃道:"只有在硅谷地区蒸馏的才能叫 Claude。"

此外,Reddit 于2025年6月起诉 Anthropic,指控其抓取了超过10万条帖子和评论用于微调 Claude,进一步加剧了"双标"质疑。

不过也有业内人士支持 Anthropic 的立场,认为保护美国AI知识产权和维护出口管制的有效性至关重要。安全公司 Oligo Security 的联合创始人 Gal Elbaz 向 CyberScoop 表示,这种行为实质上是在窃取 Anthropic 的知识产权、算力和努力成果。

Anthropic 的应对措施

根据官方博文,Anthropic 已采取多层防御策略:

构建多种分类器和行为指纹系统来识别API流量中的蒸馏攻击模式,包括检测用于构建推理训练数据的思维链引出技术;加强教育账户、安全研究项目和初创组织的验证流程(这些是设置欺诈账户最常被利用的途径);与其他AI实验室、云服务商和相关部门共享技术威胁指标;开发模型级别的反制措施,在不影响正常用户的前提下遏制非法蒸馏。

值得注意的是,据 PYMNTS 报道,Google 威胁情报组(GTIG)和 Google DeepMind 在2月12日也发布博文称,2025年期间已识别并阻断了来自全球各地研究人员和私营公司的模型提取攻击,显示这并非 Anthropic 独有的困境。

截至发稿时,DeepSeek、Moonshot AI 和 MiniMax 均未公开回应 Anthropic 的指控。TechCrunch、PYMNTS 等多家媒体表示已联系三家公司寻求评论,但尚未收到回复。

这是继 OpenAI 上月向美国国会议员发送备忘录指控 DeepSeek 蒸馏其模型之后,第二家美国前沿实验室公开提出详细证据。与 OpenAI 此前相对笼统的声明不同,Anthropic 此次披露了较为具体的数据和技术细节,包括账户数量、交互规模、各家攻击重点和基础设施特征。

但这场争议远非简单的"对与错"。几个值得关注的维度:

法律灰色地带。 蒸馏本身是合法且广泛使用的技术,问题在于规模、意图和是否违反服务条款。但 AI 训练数据来源的合法性本身就是全球性的未解争议——Anthropic 自己也为此付出了15亿美元的代价。

地缘政治背景。 这一指控的发布时机恰好卡在美国芯片出口管制辩论的敏感节点,且 DeepSeek V4 的发布迫在眉睫。Anthropic 明确将蒸馏攻击与出口管制合理性挂钩,难以完全排除政策游说的考量。

技术现实。 正如 Hacker News 上的讨论所指出的,即使隐藏思维过程输出,蒸馏在技术上仍然难以完全防范。只要有真实用户愿意出售自己的使用数据给竞争实验室,这种行为从定义上就几乎不可检测。

对于中国AI行业和用户而言,这一事件可能加速推动国产模型对海外依赖的脱钩。无论指控是否最终在法律层面得到追究,它都将深刻影响中美AI竞争的叙事和政策走向。

0

好文章,需要你的鼓励