DeepSeek V4 Lite 进入最终内测,原生支持百万级上下文窗口

2026-02-26 17:04

45

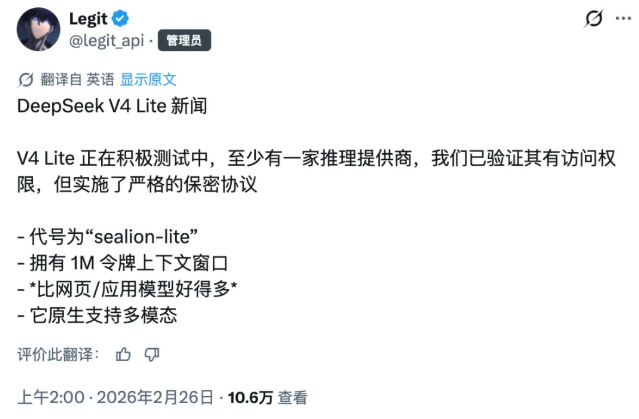

据多方消息透露,DeepSeek(深度求索)的下一代旗舰模型V4已进入发布前的关键测试阶段,正式版本预计在3月初至中旬推出。如果这次技术升级达到预期,它在长上下文、多模态和推理能力上的突破,或将进一步拉近国产大模型与国际一线水平的距离。

一、技术规格前瞻:冲击"长上下文+强推理"组合

官方目前还没放出完整的技术白皮书,但根据测试迹象和业内爆料,V4(或轻量版V4 Lite)大概会在这几个方向上有明显升级。

百万Token级上下文窗口

V4被普遍预测将支持100万token级别的上下文输入。说人话就是:你可以把整个代码仓库、一整份法律合同、或者企业内部的大型知识库一次性丢进去,让它帮你做整体分析和推理。这个能力要是落地了,基本上能跟当前国际长上下文模型阵营正面硬刚了。

原生多模态能力

V4据说会整合图像理解和文本推理,也就是图文联合分析、截图配合代码调试、报表图像解析这些你可能日常都用得到的场景。这个方向其实跟OpenAI和Anthropic近期的产品路线基本一致,大家都在往多模态这条路上走。

编程与工程能力强化

DeepSeek之前的版本在代码能力上就挺能打的,V4在多文件工程理解、长链式推理、自动补全与重构上据说还会继续加强。对开发者来说,这块升级可能是最实在的。

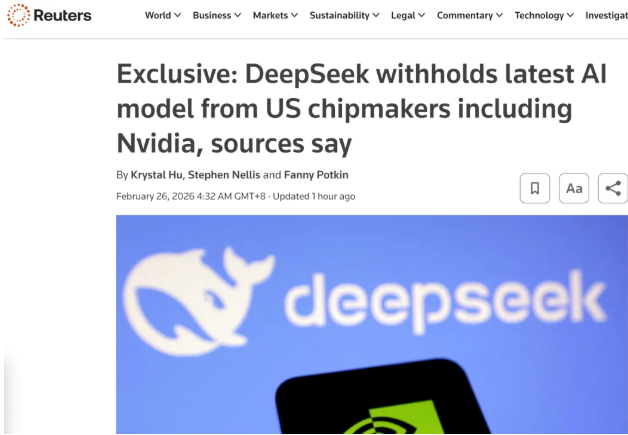

二、算力生态策略调整:优先国产适配

这次V4预发布阶段,有个细节挺耐人寻味:DeepSeek优先向国产芯片厂商开放了测试接口,华为是其中提到的合作方之一。

而Nvidia和AMD这次没有提前拿到适配版本。

这个策略变化,外界普遍解读为国产算力生态强化的信号。在全球AI芯片供应环境越来越紧的背景下,模型和算力深度绑定这件事,慢慢变成了竞争里绕不开的一环。不管你怎么看这个选择,它背后的战略意图已经相当清晰了。

三、发布时间为何延后?

春节前市场普遍预期V4会很快出来,但实际节奏比想象中慢了不少。

其实也不难理解——大模型的升级迭代涉及推理稳定性、推理成本控制、多硬件平台适配,每一块单独拎出来都不是小事,完整的验证周期往往得好几周。目前的迹象来看,V4应该已经进入发布前最后的测试阶段了,3月中旬前后落地的可能性比较高。

四、行业意义:国产大模型的"能力跃迁窗口"

如果V4在长上下文、推理和多模态上真的实现了实质性突破,那这件事的意义可以从三个层面来看:

技术层面,进一步缩小与国际一线模型的差距;生态层面,国产芯片和顶级模型之间的协同关系会更紧密;市场层面,中国开源模型在全球的话语权也会随之提升。

去年DeepSeek R1的开源策略已经在全球引发了不小的关注,V4被不少人视为一次更具规模意义的升级节点。

当然,正式发布之前,所有这些都还只是预期。V4最终能不能在关键指标上兑现这些判断,等3月份的发布见分晓吧。不管怎样,国产大模型这条赛道,节奏越来越快了。

0

好文章,需要你的鼓励