神斗士ai怎么做视频?用AI确实能实现

你要是想做那种热血战斗类的动画视频,尤其是圣斗士这种风格的,现在用AI确实能实现不少效果了。虽然说完全达到日本动画那种流畅度还有点距离,但做一些短视频素材或者概念展示已经够用了。

动画风格的选择很关键

做动画类AI视频,你得先明确自己想要什么风格。像圣斗士那种80年代日式动画的画风,跟现在流行的3D渲染风格完全是两码事。

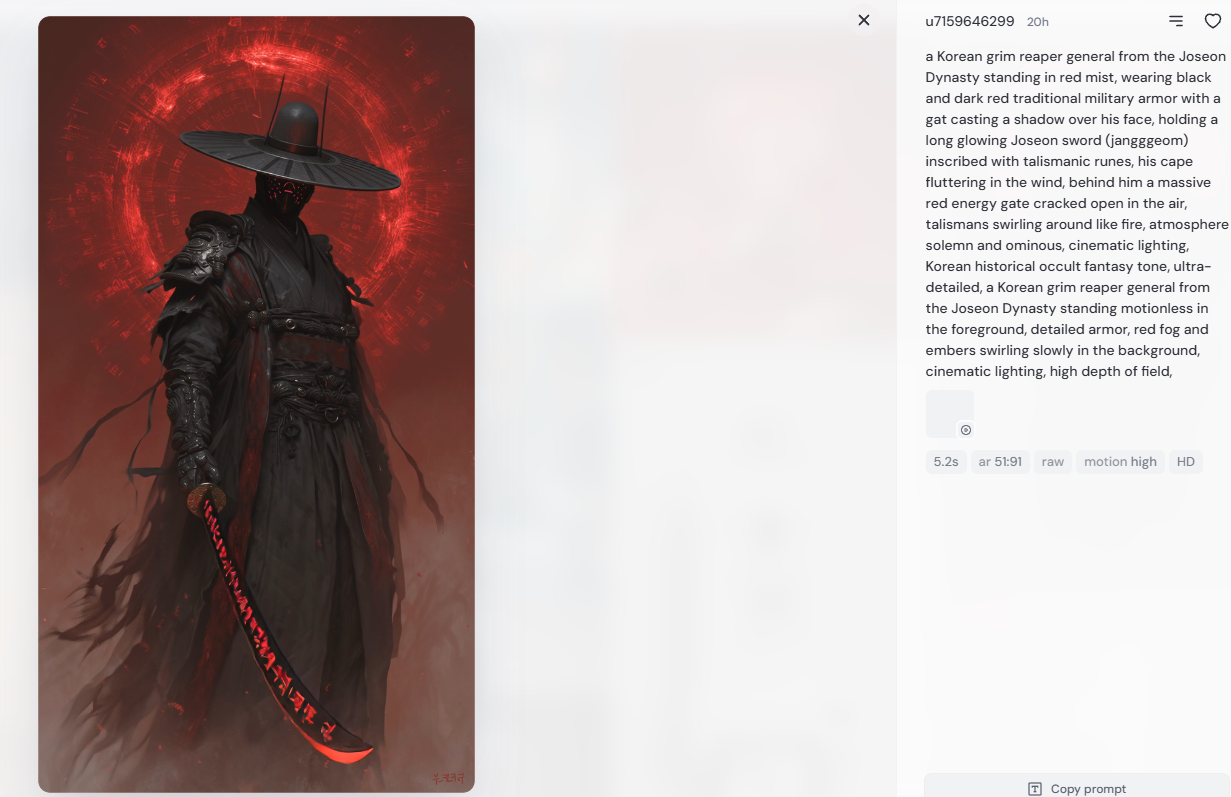

在Midjourney生成圣斗士风格的角色图,记得在提示词里必须得加上"1980s anime style"、"Masami Kurumada style"这类关键词,不然出来的画风就偏了。

Stable Diffusion在这方面其实更灵活一些,你可以用专门训练的动画模型,比如Anything V5或者那些二次元特化的模型。这些模型对日式动画的理解比通用模型好太多,生成的角色五官比例、配色都更接近真实动画。

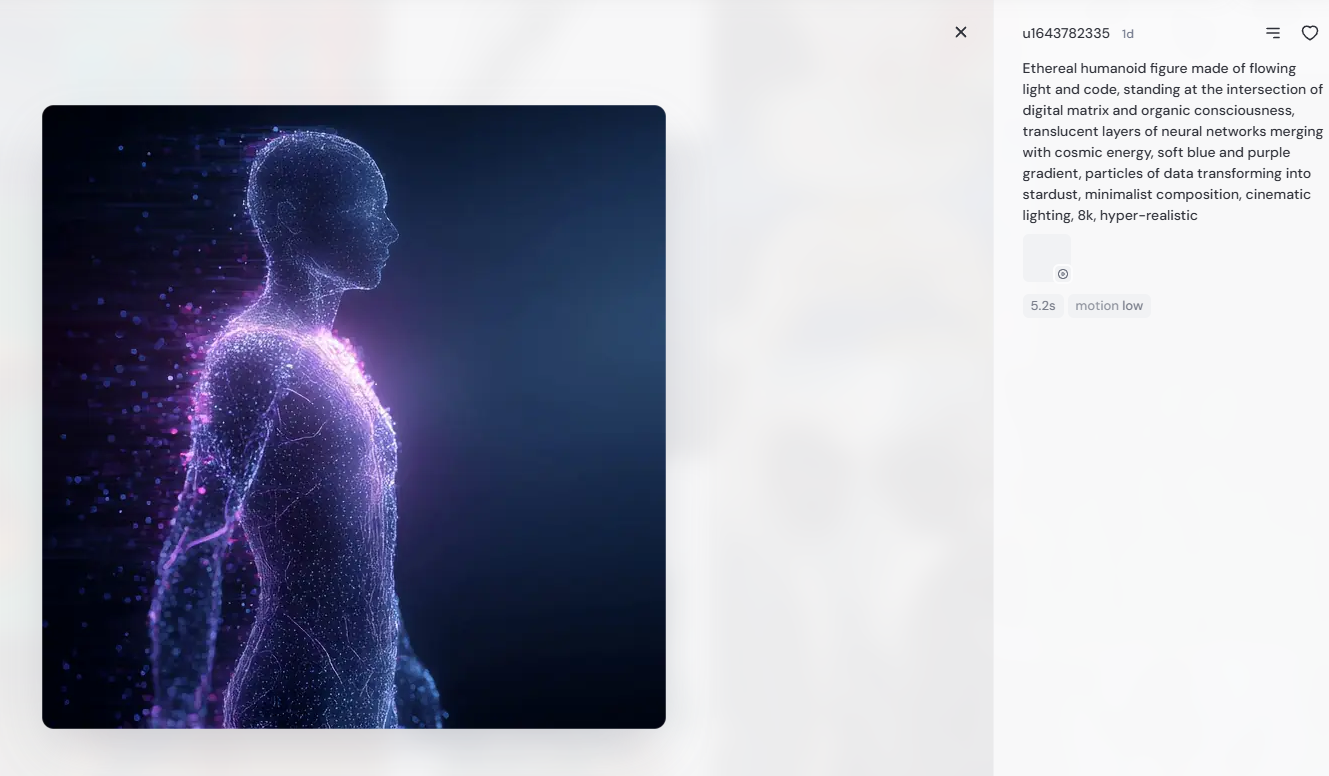

不过说实话,单张图片生成容易,要让它动起来才是难点。现在主流的办法有两种:一个是用图生视频工具,另一个是用专门的动画AI工具。

前者比如Pika、Runway的Motion Brush功能,后者像AnimateDiff这种开源方案都可以试试。

脚本+分镜得花心思

别觉得“AI能自动生成,不用写脚本”,大错特错!这种动作类的视频更需要脚本和分镜!

你得把每一秒的画面都想清楚:比如0-3秒,特写神斗士的铠甲纹路,镜头缓慢拉远;3-8秒,神斗士拔出武器,手臂肌肉(铠甲贴合处)轻微发力,背景雪花纷飞;8-15秒,挥剑释放技能,剑光带蓝色闪电特效,击中目标后有冰裂效果。

脚本里可以加“参考图提示”,比如把经典神斗士动画的截图上传当参考,AI能更精准地捕捉铠甲比例和风格,这招亲测能避开“AI乱画铠甲”的坑。

动画里那些经典的镜头语言你也得懂一点。什么时候用特写表现角色表情,什么时候用广角展示场面,这些都有讲究。

神斗士类动画特别喜欢用那种仰视角度拍英雄人物,显得很有气势。你在提示词里加上"low angle shot"、"heroic pose"这些描述,AI就能理解你的意图。

关于一致性的问题

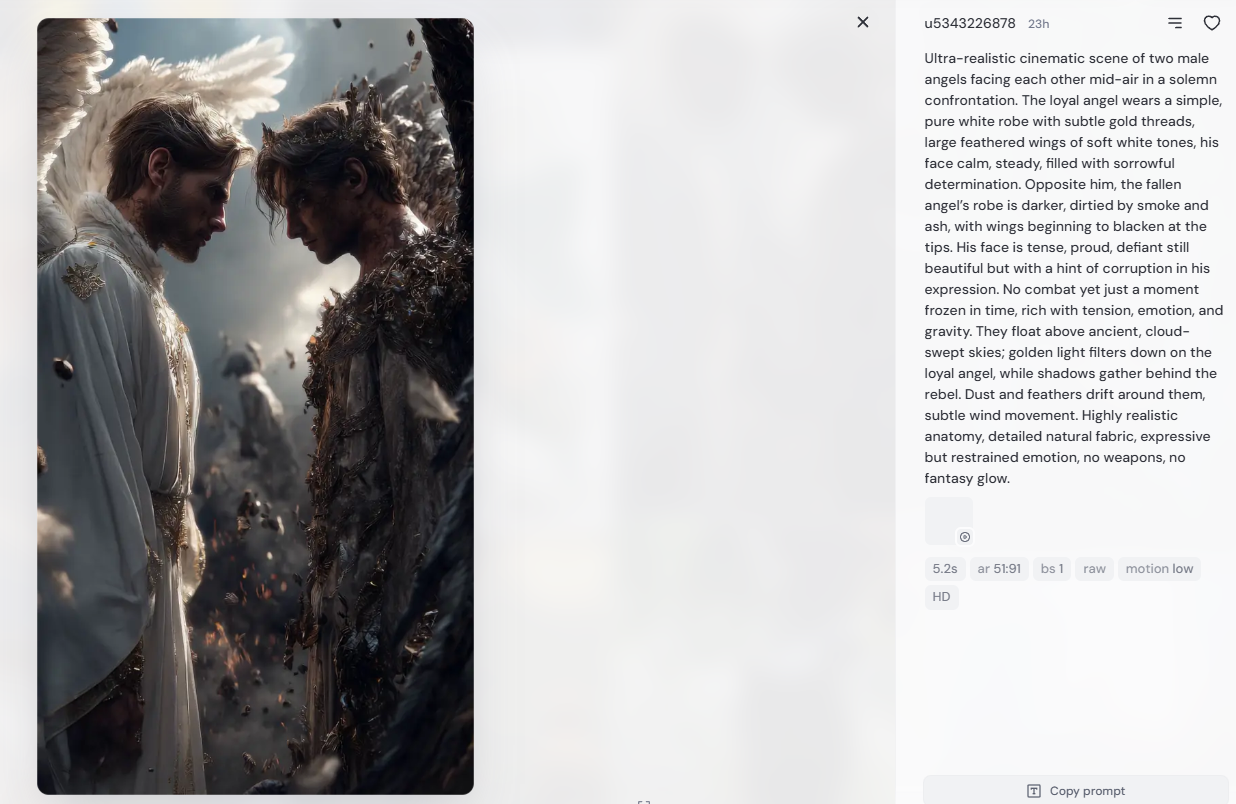

这是最头疼的地方,AI每次生成的角色长相可能都不太一样,哪怕你用了同样的提示词。

你前一个镜头里的角色穿红色铠甲,下一个镜头可能就变成蓝色了,这在动画里是绝对不能接受的。

现在有几个办法能缓解这个问题。一个是用ControlNet配合Stable Diffusion,你可以把角色的pose和轮廓固定住,让AI只负责填充细节。

还有就是使用参考图,在每次生成的时候都把之前满意的角色图作为参考输入,这样能保持较高的一致性。

Midjourney最近推出的Character Reference功能也挺好用的,你给它一张角色图,它就能在后续生成中保持这个角色的外观特征。虽然不是100%相同,但至少不会差太远。

有些朋友会问,能不能直接用真人照片转动画风格?这个方法理论上可行,但效果往往不太理想。因为真人的面部结构和动画角色差异太大,转换出来的画面会显得僵硬。除非你要的就是那种真人动画混搭的感觉,否则还是建议从零开始生成动画角色。

特效加成很重要

神斗士类动画里那些华丽的能量特效是灵魂所在,什么星云锁链、天马流星拳,没有特效的话就少了那味儿。好消息是,现在不少AI工具都能生成不错的特效元素。

你可以单独生成能量光波、爆炸、闪电这些特效素材,然后在后期软件里叠加到角色动作上。一般会用After Effects来做这个合成工作,把AI生成的特效素材调成叠加模式或者滤色模式,再调整透明度和颜色,就能做出还不错的能量爆发效果。

还有一个省事的办法是用一些专门做特效的AI插件。比如有些Stable Diffusion的插件专门生成粒子效果、光效这些东西。你把基础动画做好之后,用这些插件在需要的位置添加特效,整体效果立马就上了一个档次。

做完之后记得多看几遍,找找哪里节奏不对、哪里衔接不自然。有时候你自己看久了会产生审美疲劳,可以让朋友帮忙看看,听听他们的意见。动画制作是个反复打磨的过程,别指望一次就能做到完美。